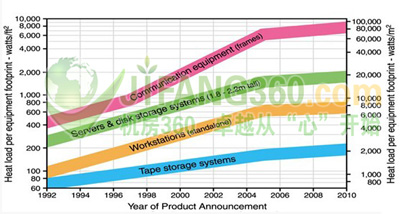

随着IT设备的更新换代,每单位空间需要慢慢的变多的电源和冷却能力,但是每单位能源可提供更高的计算能力,有必要进行适当的配置后,新服务器设备有助于用更少的设备做更多的工作,从而为数据中心运营释放电源和冷却能力。

但是先前要做的是能源评估和耗能分析,要用更科学、更合理的方法来诊断和评估现有的IT设施和制冷系统耗能问题,例如把数据中心内的所有设备的能耗进行列表排序,找出能耗最大的设备,以制定合理的能耗优化方案。

数据中心设备的复杂度非常高,在高可靠性的要求之下,对整个部门也是非常大的挑战。我们大家可以采用的解决方式是,把原来纵向的应用架构改成了新的横向架构,即服务器、存储和网络的横向管理,而不是像从前那样按照各个系统来建立支撑平台。

通过横向的调整和整合,把各类应用层全部统一管理,提出服务器存储和网络支撑共享的方略,最终达到按需分配的模式。具体而言,在整合过程中,通过机房的整合,把设备逐步整合到一起;利用互联网的整合,把原来分布在各个区域之中的服务器,对不同的终端进行支撑,构建成一个数据与存储一体化的网络架构。

首先把物理分散服务器进行物理集中,以支撑网络结构的调整。主要的思路是减少服务器,减少存储设备和相关的基础设施,把原来机房进行集中。物理集中完毕之后,然后对应用进行划分,根据划分结果进行服务器的集中,将分散在各处的服务器、维护人员进行整合,并对机房进行一定的选址及规划。

然后是服务器的逻辑集中和应用整合。先是建立服务器群组,进行应用的归类与划分;然后利用逻辑和物理分区技术,实现服务器计算能力的“动态应用”;并利用统一的分级存储结构,实现数据生命周期管理。将进行容灾系统的建设,用集中的、稳定的大服务器,代替分散的、不稳定的小服务器集群,进行灾备中心、安全中心的建设工作,以提高现在系统的可控性、可用性,并减少成本。

在整合过程中,从运营商的角度来讲要服务于具体的业务目标,而不是跟着目前的技术去走。

虚拟化是新一代数据中心使用最为广泛的技术,也是其与传统数据中心的最大差异。在新一代数据中心,通过服务器虚拟化、网络虚拟化、应用虚拟化等解决方案,不但可以帮助企业或机构减少服务器数量、优化资源利用率、简化管理,还能够在一定程度上帮助企业或机构实现动态IT基础设施环境,以此来降低成本、快速响应业务需求的变化。

硬件虚拟化体现了硬件即服务的理念,只有规模大的企业或IT投资较大的大中型企业才有机会从硬件虚拟化中受益。而对于IT投资不足的中小型企业,硬件虚拟化带来的效益可能和部署硬件虚拟化带来的成本持平。

软件虚拟化技术可适用于各个层次的企业,具有广泛适用性。对拥有数据中心的大规模的公司,可以同时使用硬件虚拟化和软件虚拟化技术,并同时获得两者带来的优势和效益;对于没有数据中心的中小型企业,使用软件虚拟化技术的性价比更高。

现在业内的数字表明,很多服务器的利用率很低。举个例子,在基于x86服务器环境中,Windows和Linux服务器利用率一般低于CPU资源的15%;很多UNIX服务器只利用了15~25%;这在某种程度上预示着服务器有75~90%的时间在消耗电源和冷却资源,却不完成任何工作。虚拟化和合并能力使您能够将多个服务器上的工作负载合并到单个服务器上,使服务器利用率提高到50~70%,并且潜在地以削减的成本在x86和UNIX服务器上完成4到6倍的工作。

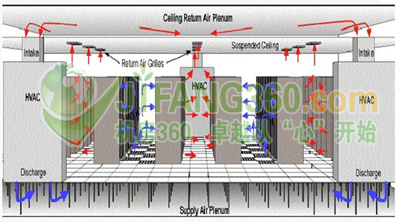

在现代机房的机柜布局中,人们为了美观和便于观察会将所的的机柜朝同一个方向摆放,如果按照这种摆放方式,机柜盲板有效阻挡冷热空气的效果将大打折扣。正确的摆放方式应该是将服务器机柜面对面或背对背的方式摆放,在机柜前设出风口,使之形成“冷”通道和“热”通道。这样机柜之间的冷风和热风就不会混合在一起形成短路气流,将提高制冷效果。

随着服务器的小形化、高密度化以及刀片式服务器的产生,使服务器摆放的位置越来越不容IT管理者忽视。这些高功率设备的发热量比普通IT设备可能要高1倍或者更多,如果将这些高功率负载密集地摆放在一个机柜内,很人容易会出现一个高密设备群并形成一个巨大的发热群体,这样的一种情况最容易导致数据中心出现局部热点,IT管理人员不得不降低整个机房环境的温度或是添加专门的制冷设备,来处理这个局部发热点。针对这样的问题,可以将这些高功率设备和高密度服务器均分在每个机柜内,这样就会减少数据中心的热点和制冷难点,制冷设备地运行费用和采购费用也随之降低。

服务器市场的惨烈竞争使其成本降低了不少,但是冷却方面的能耗却一路飙升,居高不下。根据数据中心研究机构正常运行时间学会(UPTIMEINSTITUTE)研究之后发现,由于“气流损失”,也就是“旁路气流”导致数据中心冷去的冷空气有60%都被浪费了。结果是低效的气流管理导致我们在能源方面花了许多冤枉钱。

可见,优化数据中心气流管理能够更好的降低操作成本和递延资本成本。此外,有效的管理气流还可以在不增加新的冷却设备情况下增加服务器密度。

第一, 空调机与机柜排垂直摆放且避开冷通道。当功率密度高时,空调机应分散安装。

第二, 在高功率密度数据中心,应该适当铺活动地板和调节出风口的出风速度。增加静压在总压中的比例,使冷风在地板下均匀分布。再通过送风口上设置的风量调节阀,调节每个机柜前风口地板的通风面积和风速,进而达到机柜需求供给合适的风量,以此来提高空调的效率。

第三, 可在空调机顶部安装回风道,并在热通道上方设置回风口。可以更有效地减少热空气回流,使机房内上下温度平均。

在德国慕尼黑大学的国家超级计算机HLRB-II数据中心里,这样的做法得到了升华,他们将回风道延伸到了热通道两端的上方。这种方法能够使热气流被快速大量的抽走,但是这对风道的横截面积和风速的计算都要求比较精确,防止热空气回流。并在冷热通道的两端添加了出风口,冷却少量从热通道两侧溢出的热空气,防止冷热空气混合,降冷效率。

能耗高强度的增长,使节能减排工作慢慢的变成了了基本国策,空调用电占据着机房总用电量的一半,因此也存在比较大的节能潜力。对北方地区而言,一年中有四到六个月处于10~-30℃,如果能利用冬季室外的冷量来降低机房温度,势必将节约大量能源并减少维护的工作量。

乙二醇自然冷却系统就符合这一构想。其工作原理是:在室内机蒸发器上端增加一组经济盘管,室外增加干冷器专供乙二醇循环使用,乙二醇系统为全封闭系统,乙二醇溶液为30%-70%,并且不要换掉。乙二醇溶液循环由乙二醇溶液泵为动力来实现流动,在室内换热器吸热制冷,在室外换热器放热冷却。这一系统利用的是乙二醇溶液随浓度的增加其冰点降低的原理,使用大自然提供的冷源实现制冷节能。

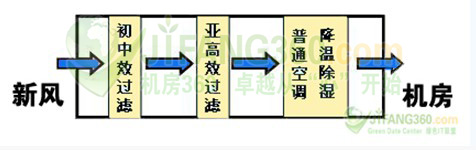

在秋季还可通过智能自控新风冷气机,减少空调的运行时间,节约空调用电的同时延长空调的常规使用的寿命,减少空调的维护费用,由此减少客户开支,提高能源利用率。

安装自控新风冷气机设备需根据实际机房面积,合理布置安装的地方,选择正真适合的设备数量,确定风量的大小,保障正常的降温需要。还要根据机房情况要做降压口。以增加空气的流动,提高新风的效果。

由于主机吸入空气温度较低,直接送入机房可能会容易结露,为防止此现状发生,故将送风口位置设在机房空调的出风口处,这样室外低温空气与机房空调大风量送风混合,在地板下形成静压,使进入机房的温度洁净度风速均在正常范围之内。

利用自控新风冷气机可以既保证室内的温度和洁净度,又能利用室内外的温差,有效地降低室内的温度,达到节能的目的。如果室外气温比较低可自行通过混风口进行混合风供给。

另外,需要在进风、排风管口加上防护网,节能新风冷气,加空气过滤网,起到保护、防尘作用。室外新风通过自控新风冷气机经管道引到空调风机下方或上方。

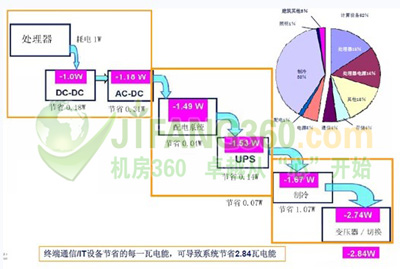

谈到数据中心节能,PUE是一个重要的指标。它反映了数据中心供电有多少被真正用于服务器计算。最好的结果是PUE为1,有多少供电全部都用于服务器计算。但实际上,这是不可能的,为保证服务器正常稳定工作,需要制冷,需要对服务器进行散热。此外,电源转换、照明、监控安防等需要消耗电力。因此,对于数据中心管理而言,就是想方设法提高PUE的效率(值越小越好)。

PUE值可分解为制冷能效因子、供电能效因子和IT设备能效,当IT设备能效等于1的情况下,降低PUE值的最有效方法就是降冷能效因子和供电能效因子。

这里的供电能效因子包括ATS开关损耗、低压配电系统损耗、供电电缆损耗和UPS系统损耗。统计数据表明出了UPS系统损耗外,其他损耗值大约为0.02,所以降低UPS系统损耗是关键。

另外,在数据中心里,即使服务器在空闲时也会消耗峰值的75%-80%,使用电源管理软件适时关闭和开启空闲服务器可降低能源峰值的45%,但是应用在需要不间断工作的系统中,很多人关注服务器再启动的响应时间问题。

目前数据中心供电系统节能的发展的新趋势已经很明显。一方面,取消高昂而耗能的隔离变压器,自试点入户变压器后,所有供电设备环节不再采用工频隔离变压器;另一方面,供电回路上,服务器工作电源是能耗最高节点,效率仅为70%-75%。未开可能采用高压直流技术(380V直流系统),大幅度减少供电系统损耗。

数据中心所需制冷量需要与IT负载热容量匹配,可随IT设备的散热量调节制冷容量和风速,消除不必要的冷量和空气循环来提高制冷系统效率。另一方面,在高热密度的数据中心里,可让冷风更接近热源,可也有实际效果的减少制冷损耗。

显然,一个设计与运营良好的数据中心,在空调系统配置正确,不考虑照明、新风机等设备情况下,能效比应该是小于1.6。现在的数据中心客户也慢慢的开始广泛关注节能与效率,目前运行的数据中心PUE基本在2~2.5范围内,新设计的数据中心客户PUE指标倾向于1.8~1.6之间,并且大的客户慢慢的开始在标书中要求采用美国流行的能效评定模型PUE指标设计。

从以上分析能够准确的看出数据中心效率发展的新趋势基本为:第一,IT设备刀片化、虚拟化,减少服务器数量,以降低服务器能耗;第二,采用直流供电技术,大幅度提升供电效率;第三,使用液体制冷技术,让冷源更接近热源,减少空气对流散热。

测量数据中心能源效率等级的电力使用效率(PUE)经常被运营商们用来区分他们的设施与其竞争对手的差别,而根据UptimeInstitute的2014年数据中心行业调查报告数据显示,大型基础设施的平均PUE值为1.7,但我们所看到的运营商们在他们的营销材料和企业社会责任报告文件中所显示的大大低于这一平均值的状况并不少见。